西班牙毕尔巴鄂德乌斯托大学的心理学家 Lucia Vicente 和 Helena Mattotti 进行的新研究提供了证据,证明人们在决策中可能继承人工智能偏差(人工智能输出中的系统性错误)。

人工智能系统所取得的惊人成果,例如可以像人类一样进行对话,赋予了这项技术高度可靠性的形象。 越来越多的专业领域正在应用基于人工智能的工具来支持专业人士的决策过程,以减少决策中的错误。 然而,由于人工智能结果存在偏差,这项技术并非没有风险。 我们必须记住,用于训练人工智能模型的数据反映了人类之前的决策。 如果这些数据隐藏了系统错误的模式,人工智能算法将学习并重现这些错误。 事实上,大量证据表明人工智能系统继承并放大了人类的偏见。

Vicente 和 Mattotti 研究中最重要的发现是,相反的效果也可能发生:人类继承了人工智能的偏见。 这意味着人工智能不仅会继承人类数据的偏见,人们也会从人工智能继承这些偏见,从而有陷入危险循环的风险。 《科学报告》杂志发表了文森特和马图特的研究结果。

在这些研究人员进行的一系列三项实验中,志愿者执行了一项医学诊断任务。 一组参与者在此任务期间得到了有偏见的人工智能系统(显示系统错误)的帮助,而对照组则没有得到帮助。 人工智能以及医疗诊断和疾病的使命都是虚构的。 整个设置是模拟的,以避免干扰真实情况。

参与者在有偏见的人工智能系统的帮助下,犯了与人工智能相同类型的错误,而对照组则没有犯这些错误。 因此,人工智能的建议影响了参与者的决策。 然而,该研究最重要的发现是,在与人工智能系统交互后,这些志愿者在转而独立执行诊断任务时,继续模仿其系统错误。 换句话说,首先从有偏见的人工智能那里获得帮助的参与者在没有这种支持的情况下复制了他们的偏见,从而表现出了固有的偏见。 对照组的参与者没有观察到这种效应,他们从一开始就在没有帮助的情况下执行了任务。

这些结果表明,人工智能模型中的偏见信息可能会对人类决策产生持久的负面影响。 AI偏差效应遗传性的发现表明需要对AI与人类之间的相互作用进行更多的心理学和跨学科研究。 此外,还需要基于证据的监管来确保人工智能的公平和道德,不仅要考虑人工智能的技术特征,还要考虑内部审计和人类协作的心理方面。

Vicente, L 和 Matute, H。人类继承了人工智能的偏见。 科学报告 (2023) https://doi.org/10.1038/s41598-023-42384-8

/一般发布。 来自原始组织/作者的这些材料本质上可能是按时间顺序排列的,并且为了清晰度、风格和长度而进行了编辑。 Mirage.News 不采取公司立场或政党立场,本文表达的所有意见、立场和结论仅代表作者的观点。在此查看全文。

“驕傲的網絡狂熱者。微妙迷人的推特怪胎。讀者。互聯網先驅。音樂愛好者。”

More Stories

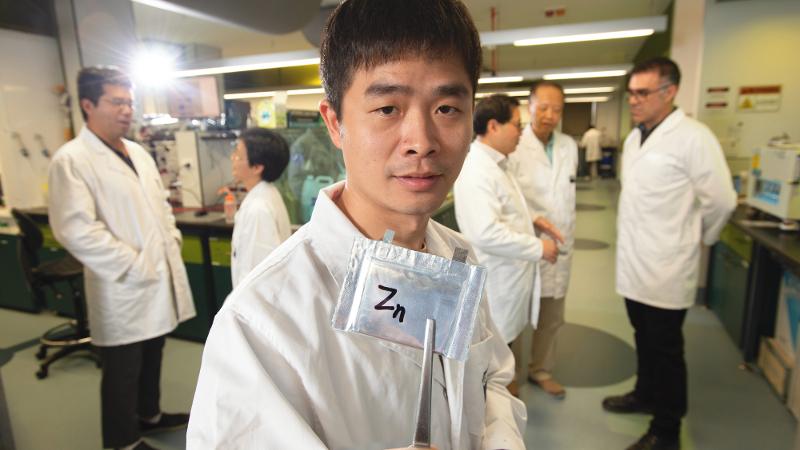

电压突破为安全、经济的电池铺平了道路

高通骁龙

《Stellar Blade》是 PS5 历史上用户评分第三高的游戏